近日,计算机视觉国际大会ICCV 2025 公布论文录用结果,小米两篇论文凭借创新性研究成果成功入选:视频理解大模型核心技术Q-Frame,创新推出行业首个动态帧选择与分辨率自适应框架,实现即插即用;持续学习框架Analytic Subspace Routing (Any-SSR),成功解决大语言模型在持续学习领域的核心难题——「灾难性遗忘」问题。

计算机视觉国际大会ICCV与国际计算机视觉与模式识别会议CVPR、欧洲计算机视觉国际会议ECCV并称为计算机领域世界三大顶级学术会议,每两年举办一次,学术影响力极高。据了解,ICCV 2025 年投稿量达 11239 篇,录用率仅 24%,此次入选充分彰显了小米在 AI 前沿领域的硬核实力。

上述两篇论文代表了小米AI团队在基座大模型领域的最新探索成果,其中视频理解大模型核心技术Q-Frame由小米AI团队全面自研,大模型持续学习框架Any-SSR由小米AI团队联合华南理工大学联合攻关。两项成果均体现了小米在 AI 技术研发上的长期投入与落地能力,展现出从前沿探索到生态应用的全链条技术积累。

01全自研视频理解大模型核心技术Q-Frame,拥有多个“行业首次”创新

在视频理解大模型(Video-LLMs)的研究中,传统 “均匀帧采样” 处理方式存在时间碎片化信息丢失、盲目采样及算力浪费等问题。小米AI团队针对此痛点,推出全自研的 Q-Frame核心技术,该成果以论文《Q-Frame: Query-aware Frame Selection and Multi-Resolution Adaptation for Video-LLMs》入选 ICCV 2025。

Q-Frame 作为视频理解大模型核心技术,是行业首个动态帧选择与分辨率自适应框架,也是首个无需训练,市面上各类视频理解大模型基座均可即插即用的算法框架。

Q-Frame 拥有三大行业首次创新:跨模态查询检索(Cross-modal Query Retrieval, CQR)、查询感知帧选择(Query-aware Frame Selection, QFS)、多分辨率自适应(Multi-Resolution Adaptation, MRA),能够精准理解视频内容与用户问题,通过精准捕捉跟用户问题最相关的视频关键内容,将有效信息量提升 5 倍。

在 MLVU 评测集上,Q-Frame 使 Qwen2-VL 的理解准确率从 55.5% 提升至 65.4%;在 LongVideoBench 上,让 GPT-4o 的准确率从 53.3% 提升到 58.6% 。此外,其多分辨率自适应特性可根据内容重要性和查询需求动态调整帧分辨率,避免算力浪费。

通过采用动态查询感知帧选择和多分辨率自适应,Q-Frame还有效解决了「均匀帧采样」策略下时间碎片化的信息丢失、问题无感知的盲目采样和分辨率一刀切的算力浪费三大难题。与传统均匀选帧、统一处理方式不同,在有限计算资源下,Q-Frame 可使模型更高效准确理解视频。

此外,Q-Frame 具有即插即用(plug-and-play)的特点,可与市场上现有的各类视频理解大模型兼容,无论是开源模型还是闭源模型,无需对模型进行额外的训练或微调。以 VILA-V1.5 和 Qwen2-VL 等开源模型为例,在集成 Q-Frame 后,这些模型在视频理解任务上的性能均得到了显著提升。同样,对于闭源的 GPT-4o 模型,Q-Frame 也展现出了良好的兼容性,进一步证明了其广泛的适用性。

Q-Frame在小米「人车家全生态」战略中有着多元的应用场景,目前正在持续探索和落地。例如前不久小米YU7发布时提到的哨兵模式中,能够分清楚普通的风吹草动和可能带来剐蹭、碰撞的危险行为,像一个会“智能巡逻”的保安一样为用户保驾护航;智能家居中,能够在浩如烟海的监控画面中找到最关键的画面,帮助用户解答问题;在小爱视频问答场景中,可以直接定位到视频中能够解答问题的片段开始播放…

02大模型持续学习框架Any-SSR,创新解决LLM持续学习「灾难性遗忘」难题

在大语言模型(LLMs)持续学习(Continual Learning, CL)领域,往往会因新任务的学习而导致对旧任务知识的遗忘,即灾难性遗忘问题,这极大地限制了模型在实际动态应用场景中的表现与拓展。小米 AI 团队联合华南理工大学针对这一难题开展研究,其成果《Analytic Subspace Routing: How Recursive Least Squares Works in Continual Learning of Large Language Model》成功入选 ICCV 2025。

Any-SSR框架作为行业首个将递归最小二乘法(Recursive Least Squares, RLS)引入大语言模型持续学习的技术框架,开创性地通过分析路由机制,动态地把不同任务分配到独立子空间学习,避免任务间知识干扰,创新性解决了大语言模型持续学习中灾难性遗忘问题。同时,利用低秩适应(Low-Rank Adaptation, LoRA)与分析路由相结合的方式,实现了新旧知识的无缝整合与动态学习。

在一系列技术创新的基础上,Any-SSR方法实现了近乎完美的知识保留(即不遗忘),同时能无缝地学习新知识。在实验中,Any-SSR 在 TRACE 基准测试上的表现显著优于其他方法,包括多任务学习(MTL)等,不仅在整体性能(OP)上取得了优异成绩,还实现了零反向知识转移(BWT)。

在实际应用层面,以小米新零售业务为例。由于小米生态在售商品超过 1500 款,涵盖手机、家电、智能硬件等多个领域,使得产品品类繁多、上新速度快、售后问题复杂众多。小米此前推出的“店员 Copilot” AI 工具,通过运用Any-SSR框架,有效降低了学习查询产品知识门槛,能对上千种商品的上新、售后等问题进行高效回答,提升专业水平与服务质量。

自 2023 年确立「人车家全生态」战略以来,小米始终坚持 “软硬深度融合、AI 全面赋能”,将 AI、芯片、操作系统作为突破硬核科技的三大底层核心赛道。AI 技术作为驱动全生态发展的核心引擎,已经深度融入到小米人、车、家各个业务线,此次入选 ICCV 2025 的两篇重磅论文成果,是小米坚定落实 「人车家全生态」战略与 AI 子战略的生动体现。

过去五年,小米集团研发投入高达约 1020 亿元,在2025年的300亿研发投入中,大约有四分之一将被用于AI相关方向。未来五年(2026-2030 年),小米还将在核心技术赛道再投入 2000 亿元。我们会全力以赴,保持战略耐性,持续加大投资,以创新成果推动行业发展,为用户带来更加智能、便捷的全生态产品与服务体验。

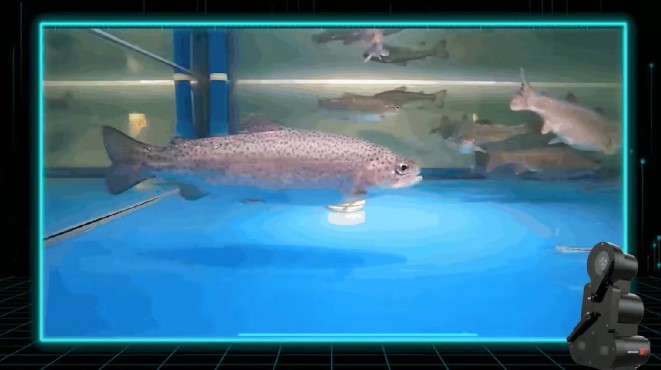

海康威视水下立体视觉摄像机助力智慧养殖

海康威视水下立体视觉摄像机助力智慧养殖 今日AI前沿:三月下旬三大热搜炸场,行业格局一夜变天

今日AI前沿:三月下旬三大热搜炸场,行业格局一夜变天 美国酝酿收紧AI芯片出口

美国酝酿收紧AI芯片出口  中国AI调用量首超美国 四款大模型霸榜全球前五

中国AI调用量首超美国 四款大模型霸榜全球前五

精彩评论